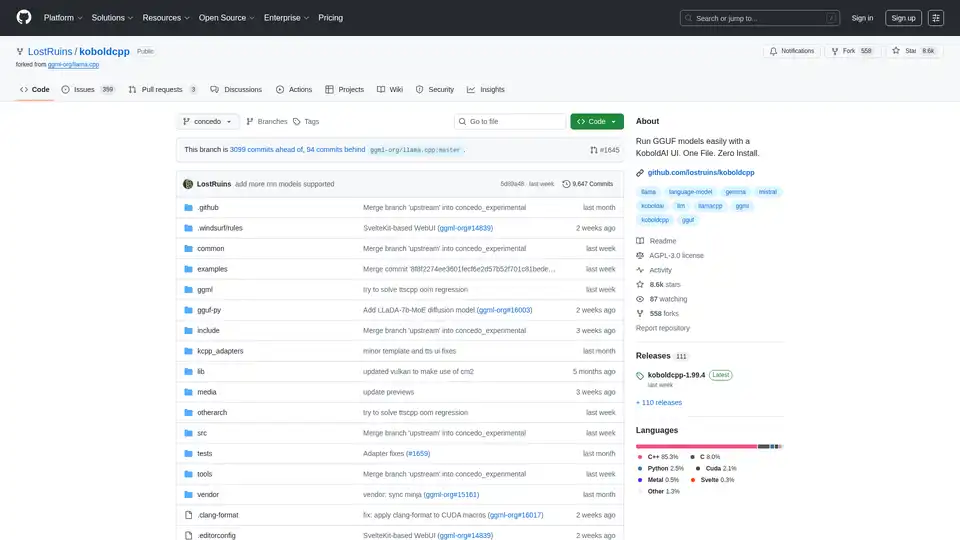

KoboldCpp の概要

KoboldCpp:オールインワンのAIテキストおよび画像生成ソリューション

KoboldCppとは? KoboldCppは、テキストと画像の生成の両方のために設計された、汎用性の高い、ユーザーフレンドリーなAIソフトウェアです。オリジナルのKoboldAIに触発され、GGMLおよびGGUFモデルの実行プロセスを簡素化し、インストールを必要としない単一の自己完結型実行可能ファイルを提供します。

主な機能

- 単一ファイル実行可能ファイル: インストールや外部依存関係は不要です。

- CPUおよびGPUのサポート: CPUとGPUの両方で効率的に実行され、完全または部分的なオフロードのオプションがあります。

- LLMテキスト生成: すべてのGGMLおよびGGUFモデルと互換性があり、下位互換性を保証します。

- 画像生成: 高品質の画像を生成するために、Stable Diffusion 1.5、SDXL、SD3、およびFluxをサポートします。

- 音声テキスト変換: 音声認識のためにWhisperを統合します。

- テキスト読み上げ: 音声生成のためにOuteTTS、Kokoro、Parler、およびDiaをサポートします。

- APIエンドポイント: KoboldCppApi、OpenAiApi、OllamaApiなどの一般的なWebサービスと互換性のあるAPIエンドポイントを提供します。

- バンドルされたUI: 編集ツール、保存形式、メモリ、世界情報、著者のメモ、キャラクター、およびシナリオを備えたKoboldAI Lite UIが含まれています。

- 複数のモードとテーマ: チャット、アドベンチャー、インストラクト、およびストーリーライターモード、およびさまざまなUIテーマを提供します。

- データ形式のサポート: Tavern Character Cards、JSON保存ファイル、および永続的なストーリーをサポートします。

- 追加機能: 新しいサンプラー、正規表現のサポート、Web検索、TextDB経由のRAG、および画像認識/ビジョンが含まれています。

- クロスプラットフォーム: Windows、MacOS、およびLinux用のすぐに使用できるバイナリ、Colab、Docker、Android(Termux経由)、およびRaspberry Piのサポート。

KoboldCppの仕組み

KoboldCppは、llama.cppとstable-diffusion.cppの力を活用して、シームレスなAIエクスペリエンスを提供します。その仕組みは次のとおりです。

- テキスト生成のためにGGMLまたはGGUFモデルをロードします。

- 画像生成のためにStable Diffusionモデルを利用します。

- 音声認識のためにWhisperを、音声生成のためにさまざまなTTSエンジンを採用します。

- 他のサービスとの統合のためにAPIエンドポイントを提供します。

KoboldCppの使用方法

- ダウンロード: 公式リリースページから、オペレーティングシステム用の最新のKoboldcpp実行可能ファイルを入手します。

- 実行: ダウンロードしたファイルを実行するだけです。インストールは不要です。

- モデルのロード: Hugging FaceなどのソースからGGUFモデルを入手します。初心者は、

L3-8B-Stheno-v3.2、Tiefighter 13B、またはGemma-3-27B Abliteratedが適切である可能性があります。 - 接続: デフォルトでは、

http://localhost:5001からKoboldCppにアクセスできます。

Windowsでの使用

koboldcpp.exeファイルをダウンロードします。- 実行可能ファイルを実行してGUIを起動します。

- GGUFモデルをロードし、ローカルサーバーに接続します。

Linuxでの使用

koboldcpp-linux-x64バイナリをダウンロードします。chmod +x koboldcpp-linux-x64を使用して、ファイルを実行可能にします。./koboldcpp-linux-x64を使用してバイナリを実行します。

MacOSでの使用

- MacOSバイナリをダウンロードします。

chmod +x koboldcpp-mac-arm64を使用して、ファイルを実行可能に設定します。./koboldcpp-mac-arm64を使用してバイナリを実行します。

Colabでの実行

KoboldCppは、簡単なセットアップと使用のための公式のColab GPU Notebookを提供しています。

RunPodでの実行

KoboldCppは、スケーラブルなパフォーマンスのためにRunPodクラウドGPUにデプロイできます。

パフォーマンスの最適化

- GPUアクセラレーション:

--usecuda(Nvidia)または--usevulkan(任意のGPU)フラグを使用します。 - GPUレイヤーのオフロード:

--gpulayersを使用して、モデルレイヤーをVRAMにオフロードします。 - コンテキストサイズ:

--contextsizeを使用してコンテキストサイズを増やします。 - CPUの互換性: 古いCPUの場合は、

--noavx2を使用します。

KoboldCppは誰のためのものですか?

KoboldCppは以下に最適です。

- テキストと画像の生成のためのシンプルでオールインワンのソリューションを求めているAI愛好家。

- AI機能をアプリケーションに統合するためのAPIエンドポイントを探している開発者。

- ストーリーテリング、ロールプレイング、およびコンテンツ作成プロセスを強化するためのツールを探しているクリエイター。

KoboldCppを選択する理由

KoboldCppが際立っているのは、次の点です。

- 使いやすさ

- 包括的な機能セット

- クロスプラットフォームの互換性

- パフォーマンス最適化オプション

追加リソース

- モデル: Hugging FaceでGGUFテキストモデルを、CivitAIで画像モデルを見つけます。

- ドキュメント: エンドポイントの詳細については、KoboldAI APIドキュメントを参照してください。

- コミュニティ: サポートとディスカッションについては、KoboldAI Discordサーバーに参加してください。

KoboldCppは、AI駆動のテキストおよび画像生成を簡素化し、幅広いユーザーがアクセスできるようにします。ストーリーの生成、画像の作成、またはプロジェクトへのAIの統合のいずれであっても、KoboldCppは堅牢でユーザーフレンドリーなソリューションを提供します。さまざまなプラットフォームをサポートし、最適化オプションを提供することにより、スムーズで効率的なAIエクスペリエンスを保証します。次のAIプロジェクトのためにKoboldCppを検討してください。

"KoboldCpp" のベストな代替ツール

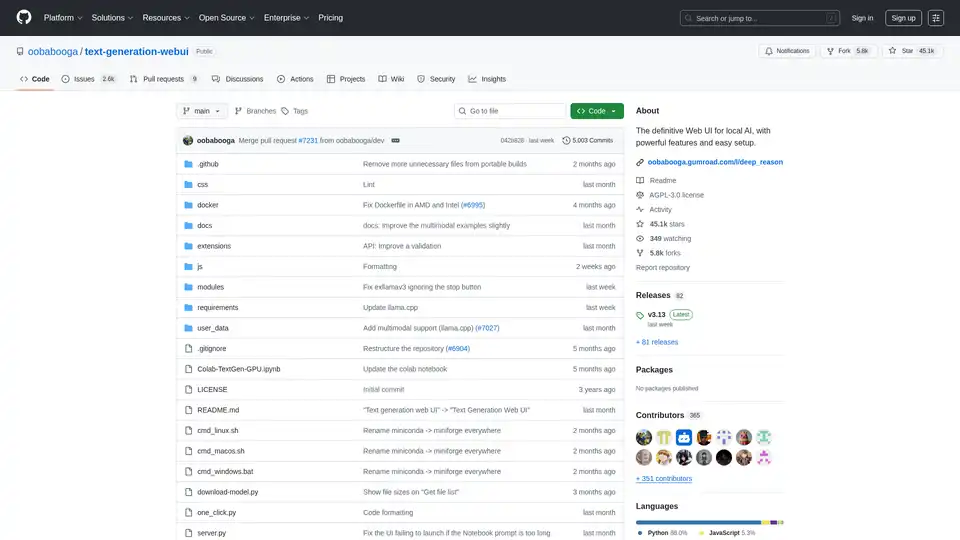

Text Generation Web UIは、ローカルAI大規模言語モデル用の強力で使いやすいGradio Webインターフェースです。複数のバックエンド、拡張機能をサポートし、オフラインプライバシーを提供します。

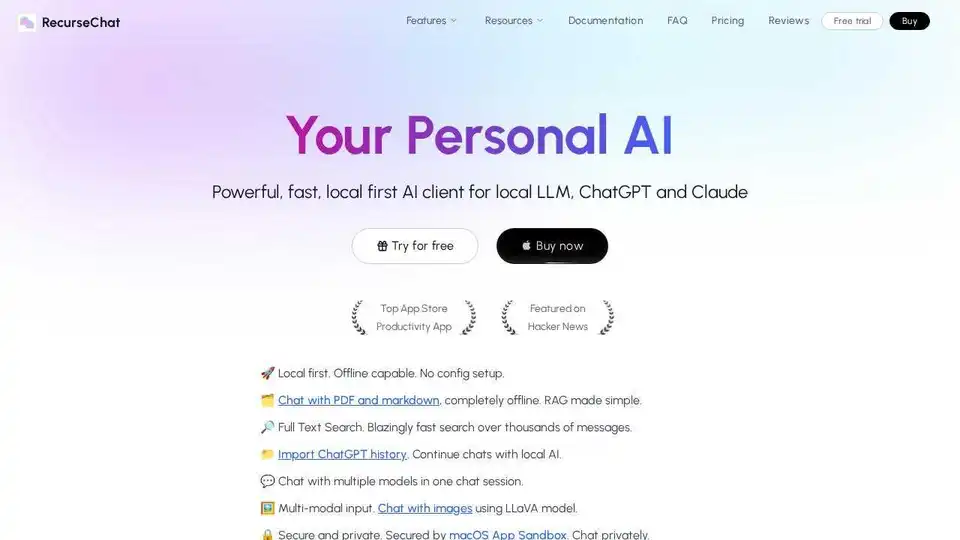

RecurseChat:ローカルAIと対話できるパーソナルAIアプリ。オフライン対応で、PDFやmarkdownファイルとのチャットも可能です。

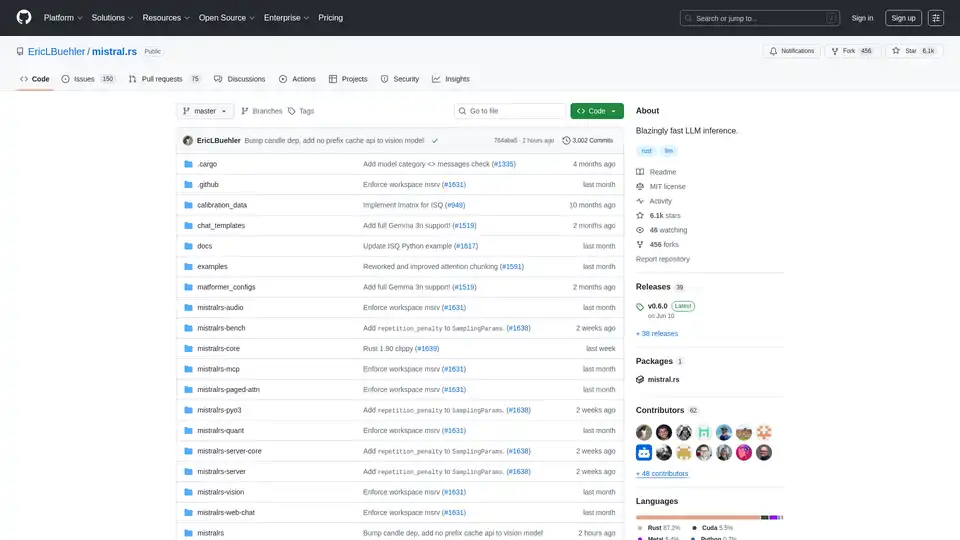

mistral.rsは、Rustで記述された非常に高速なLLM推論エンジンであり、マルチモーダルワークフローと量子化をサポートしています。Rust、Python、およびOpenAI互換のHTTPサーバーAPIを提供します。

AI Actions は、GPT-4o、Claude、DALL·E などの強力な AI 統合で Apple の Shortcuts アプリを強化し、iOS と macOS で安全でカスタマイズ可能な自動化を実現するための独自の API キーを使用します。