local.ai 개요

Local AI Playground: 오프라인 AI 실험을 위한 관문

Local AI Playground란 무엇입니까?

Local AI Playground는 local.ai에서 제공하는 무료 오픈 소스 네이티브 애플리케이션으로, GPU 없이도 로컬에서 AI 모델을 실험하는 프로세스를 단순화하도록 설계되었습니다. 이를 통해 오프라인, 비공개로 AI 추론을 실행할 수 있으며 초보자와 고급 사용자 모두에게 간소화된 경험을 제공합니다.

local.ai는 어떻게 작동합니까?

Local.ai는 사용자 친화적인 인터페이스와 효율적인 Rust 백엔드를 통해 AI 모델 관리, 검증 및 추론을 단순화합니다. 주요 기능 및 기능에 대한 분석은 다음과 같습니다.

주요 기능:

- CPU 추론: 사용 가능한 스레드에 적응하고 효율적인 CPU 기반 AI 추론을 위해 GGML 양자화(q4, 5.1, 8, f16)를 지원합니다.

- 모델 관리: AI 모델을 추적하기 위한 중앙 집중식 위치로, 재개 가능한 동시 다운로더, 사용량 기반 정렬 및 디렉토리에 구애받지 않는 설정과 같은 기능이 있습니다.

- 다이제스트 검증: BLAKE3 및 SHA256 다이제스트 계산, 알려진 양호한 모델 API 및 라이선스/사용 칩으로 모델 무결성을 보장합니다.

- 추론 서버: AI 추론을 위한 로컬 스트리밍 서버를 단 두 번의 클릭으로 시작하여 빠른 추론 UI를 제공하고 출력을 .mdx 파일에 씁니다.

사용 가능한 기능:

- 스트리밍 서버

- 빠른 추론 UI

- .mdx에 쓰기

- 추론 매개변수

- 원격 어휘

- 다이제스트 계산

- 알려진 양호한 모델 API

- 라이선스 및 사용 칩

- BLAKE3 빠른 검사

- 모델 정보 카드

예정된 기능:

- GPU 추론

- 병렬 세션

- 중첩된 디렉토리

- 사용자 정의 정렬 및 검색

- 모델 탐색기

- 모델 검색

- 모델 추천

- 서버 관리자

- /audio

- /image

local.ai 사용 방법:

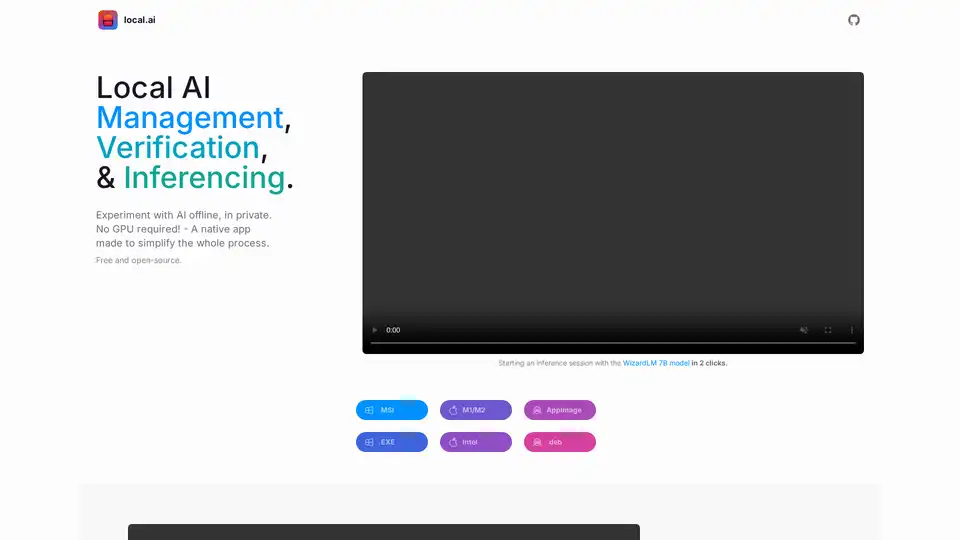

- 다운로드 및 설치: 운영 체제에 적합한 버전(.MSI, .EXE, M1/M2, Intel, AppImage, .deb)을 다운로드합니다.

- 모델 관리: AI 모델을 추적할 디렉토리를 선택합니다. 이 앱은 재개 가능한 다운로드 및 사용량 기반 정렬과 같은 기능을 제공합니다.

- 추론 서버: 모델을 로드하고 단 두 번의 클릭으로 서버를 시작하여 AI 추론을 시작합니다.

local.ai가 중요한 이유는 무엇입니까?

- 개인 정보 보호: 오프라인 및 비공개로 AI 모델을 실행합니다.

- 접근성: GPU가 필요하지 않아 더 많은 사용자가 AI 실험에 액세스할 수 있습니다.

- 효율성: Rust 백엔드는 메모리 효율성과 컴팩트한 공간을 보장합니다.

- 오픈 소스: 무료 오픈 소스로, 커뮤니티 기여 및 투명성을 장려합니다.

local.ai를 어디에서 사용할 수 있습니까?

Local.ai는 다음을 포함한 다양한 설정에서 사용할 수 있습니다.

- AI 개발: 클라우드 서비스에 의존하지 않고 AI 모델을 테스트하고 실험합니다.

- 교육 목적: 실습 오프라인 환경에서 AI 개념을 배우고 이해합니다.

- 개인 정보 보호에 민감한 애플리케이션: 데이터를 외부 서버로 전송하지 않고 민감한 데이터에서 AI 모델을 실행합니다.

local.ai를 시작하는 가장 좋은 방법은 무엇입니까?

local.ai를 다운로드한 다음 몇 번의 클릭만으로 WizardLM 7B 모델 또는 기타 오픈 소스 모델을 실험해 보십시오. local.ai는 모든 AI 모델을 오프라인 또는 온라인으로 관리하는 데 도움이 되는 간소화된 프로세스와 강력한 기능을 제공합니다.

"local.ai"의 최고의 대체 도구

Local AI는 로컬에서 AI 모델을 실험하는 것을 단순화하는 무료 오픈 소스 기본 애플리케이션입니다. CPU 추론, 모델 관리 및 다이제스트 검증을 제공하며 GPU가 필요하지 않습니다.

DeepSeek V3를 등록 없이 무료로 온라인에서 사용해 보세요. 이 강력한 오픈소스 AI 모델은 671B 매개변수를 가지고 있으며, 상업적 사용을 지원하며, 브라우저 데모 또는 GitHub 로컬 설치로 무제한 액세스를 제공합니다.

Anyscale은 Ray에서 제공하며 모든 클라우드 또는 온프레미스에서 모든 ML 및 AI 워크로드를 실행하고 확장하기 위한 플랫폼입니다. AI 애플리케이션을 쉽고 효율적으로 구축, 디버그 및 배포하십시오.