DragGAN

Visão geral de DragGAN

DragGAN: Manipulação Interativa Baseada em Pontos no Múltiplo de Imagens Generativas

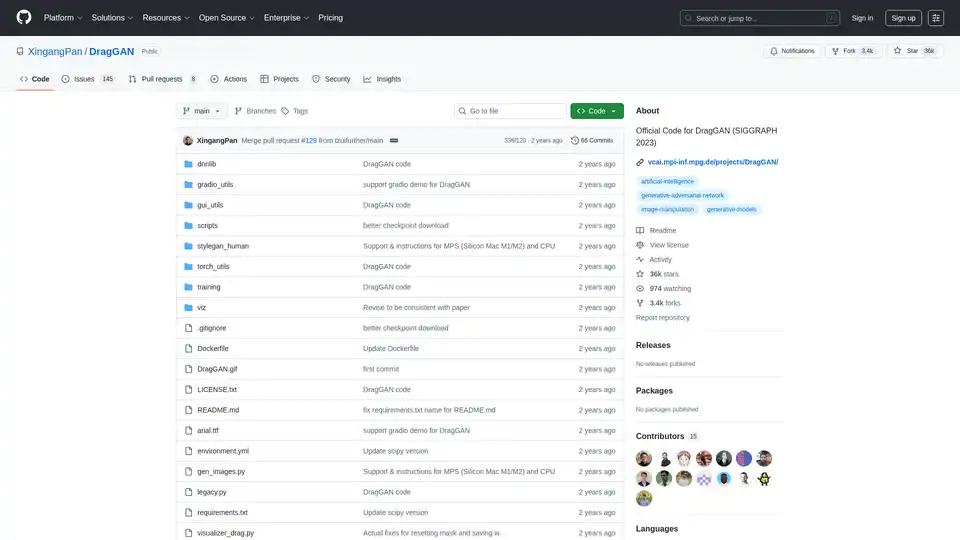

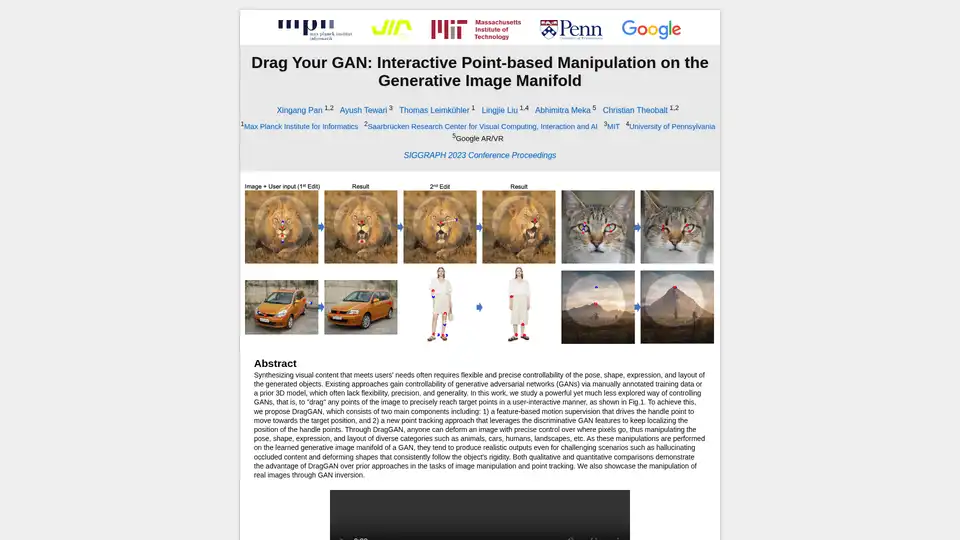

DragGAN é uma técnica de ponta que permite aos usuários manipular interativamente imagens geradas por Redes Adversariais Generativas (GANs). Essa abordagem inovadora permite um controle preciso, baseado em pontos, sobre os recursos da imagem, abrindo novas possibilidades para edição e manipulação criativa de imagens. O código oficial do DragGAN foi apresentado no SIGGRAPH 2023.

O que é DragGAN?

DragGAN é um método para manipular imagens geradas por GANs, especificamente StyleGAN. Ele permite que os usuários selecionem pontos específicos em uma imagem e os "arrastem" para novos locais, deformando efetivamente a imagem de maneira controlada. Isso é conseguido otimizando o espaço latente da GAN, guiando o processo de geração de imagens para corresponder à manipulação pretendida pelo usuário.

Como funciona o DragGAN?

DragGAN opera permitindo que os usuários selecionem "pontos de controle" em uma imagem e especifiquem os locais de destino para esses pontos. O algoritmo então otimiza a representação do espaço latente da GAN da imagem para mover os pontos de controle para seus destinos, preservando a qualidade geral da imagem e o realismo. Isso envolve um equilíbrio cuidadoso entre mover os pontos especificados e manter a integridade das estruturas de imagem circundantes.

Principais recursos e capacidades:

- Manipulação interativa baseada em pontos: DragGAN permite que os usuários manipulem diretamente as imagens selecionando e arrastando pontos específicos, oferecendo controle intuitivo sobre a edição de imagens.

- Múltiplo de imagens generativas: O método opera dentro do múltiplo de imagens generativas aprendidas pelas GANs, garantindo que as manipulações permaneçam realistas e consistentes com os dados de treinamento.

- Resultados de alta qualidade: DragGAN foi projetado para produzir resultados de alta qualidade, preservando os detalhes da imagem e evitando artefatos durante a manipulação.

- Integração com StyleGAN: A implementação é baseada em StyleGAN3, aproveitando seus poderosos recursos de geração de imagens.

Como usar o DragGAN?

- Requisitos:

- GPU habilitada para CUDA (recomendado)

- Ambiente Conda

- Python 3.7+

- Dependências especificadas em

environment.ymlerequirements.txt

- Instalação:

- Crie um ambiente Conda usando o arquivo

environment.ymlfornecido:conda env create -f environment.yml - Ative o ambiente:

conda activate stylegan3 - Instale requisitos adicionais:

pip install -r requirements.txt

- Crie um ambiente Conda usando o arquivo

- Baixar pesos pré-treinados:

- Execute

python scripts/download_model.pypara baixar os pesos StyleGAN2 pré-treinados.

- Execute

- Executar a GUI DragGAN:

- Execute

sh scripts/gui.sh(ou.\scripts\gui.batno Windows) para iniciar a GUI DragGAN. Isso permite que os usuários editem imagens geradas por GAN.

- Execute

Por que escolher o DragGAN?

DragGAN se destaca por sua interface intuitiva e resultados de alta qualidade. Ao contrário das técnicas tradicionais de edição de imagens, o DragGAN opera dentro do espaço latente da GAN, garantindo que as manipulações permaneçam realistas e consistentes. Isso o torna uma ferramenta ideal para edição criativa de imagens, permitindo que os usuários explorem novas possibilidades e gerem conteúdo visual exclusivo.

Para quem é o DragGAN?

DragGAN é adequado para:

- Pesquisadores: Investigando GANs e técnicas de manipulação de imagem.

- Artistas e designers: Criação de conteúdo visual exclusivo e atraente.

- Hobbistas: Explorando os recursos da edição de imagem orientada por IA.

Detalhes técnicos e implementação:

A implementação do DragGAN é baseada em StyleGAN3 e inclui vários componentes principais:

- DNNLib: Uma biblioteca para redes neurais profundas.

- Gradio Utils: Utilitários para criar um visualizador baseado em Gradio.

- GUI Utils: Utilitários para a GUI DragGAN.

- Torch Utils: Utilitários para PyTorch.

Informações de licença:

O código relacionado ao algoritmo DragGAN é licenciado sob CC-BY-NC. No entanto, a maior parte deste projeto está disponível sob termos de licença separados: todos os códigos usados ou modificados do StyleGAN3 estão sob a Licença de Código Fonte Nvidia. Qualquer forma de uso e derivado deste código deve preservar a funcionalidade de marca d'água mostrando "AI Generated".

Exemplos de casos de uso

- Remodelação de objeto: Modifique a forma de objetos dentro de uma imagem, como alterar a pose de um rosto ou remodelar um carro.

- Composição de cena: Reorganize elementos dentro de uma cena para criar novas composições e narrativas visuais.

- Exploração artística: Experimente diferentes manipulações de imagem para gerar obras de arte exclusivas e criativas.

DragGAN é uma ferramenta poderosa que desbloqueia novas possibilidades para manipulação interativa de imagens. Ao combinar o poder das GANs com o controle intuitivo baseado em pontos, o DragGAN permite que os usuários criem edições de imagem impressionantes e realistas com facilidade.

Melhores ferramentas alternativas para "DragGAN"

DragGAN permite aos usuários manipular interativamente imagens geradas por GAN arrastando pontos para locais de destino, oferecendo controle preciso sobre pose, forma e layout.

Nano Banana é um editor de imagens AI do Google que permite a edição de imagens baseada em texto com resultados naturais e edição de personagens consistente. Ele oferece uma forma gratuita de experimentar o futuro da manipulação de imagens AI.

Descubra Nano Banana AI, a ferramenta alimentada por Gemini do Google para edição de imagens baseada em texto. Mantenha a consistência de personagens e integre conhecimento do mundo real para resultados rápidos e profissionais.

ImgTools é uma ferramenta de captura de tela e edição de imagens baseada em navegador que permite aos usuários capturar, editar, embelezar, comprimir e marcar com água imagens diretamente no navegador sem fazer upload de arquivos.