Private LLM の概要

Private LLM: iPhone、iPad、Macで検閲なしのチャットができるローカルAI

Private LLMとは? Private LLMは、iOSとmacOS向けに設計されたローカルAIチャットボットで、iPhone、iPad、Mac上で直接、プライベートで検閲のない会話を行うことができます。完全にオフラインで動作するため、データは安全に保護され、デバイスから離れることはありません。

主な機能:

- オフライン機能: インターネット接続なしで動作し、完全なデータプライバシーを確保します。

- サブスクリプション不要: 1回の購入で、すべてのAppleデバイスでアクセスできます。

- オープンソースAIモデル: DeepSeek R1 Distill、Llama 3.3、Phi-4、Qwen3、Google Gemma 2など、主要なオープンソースAIモデルをサポートしています。

- Siriとショートカットとの統合: コーディングなしで、カスタムのAI駆動型ワークフローを作成できます。

- ファミリー共有: 最大6人の家族が、1回の購入でアプリを使用できます。

- AI言語サービス: 文法修正、要約などにより、すべてのmacOSアプリでの執筆を強化します。

- OmniQuant量子化: 最新のOmniQuant量子化を使用し、優れたモデルパフォーマンスを実現します。

Private LLMの仕組みは?

Private LLMは、OmniQuant量子化を使用してデバイス上でのパフォーマンス向けに最適化されたオープンソースAIモデルを活用しています。この技術は、LLMの重みの外れ値の影響を最小限に抑え、モデルの重み分布を維持し、高品質のテキスト生成を保証します。このアプリは、SiriとAppleのショートカットとの統合をサポートしており、ユーザーはコードを書かずにカスタムのAI駆動型ワークフローを作成できます。このアプリはx-callback-urlもサポートしており、70以上の人気のあるiOSおよびmacOSアプリケーションとシームレスに統合できます。

Private LLMを選ぶ理由は?

Private LLMは、プライバシーへのコミットメント、オフライン機能、および主要なオープンソースAIモデルのサポートにより際立っています。クラウドベースのAIサービスとは異なり、Private LLMはデータが完全にデバイス上に残ることを保証し、安全でプライベートなAI体験を提供します。また、recurring サブスクリプションの必要性を排除する1回限りの購入モデルも提供しています。

Private LLMは誰のためのものですか?

Private LLMは、プライバシーとセキュリティを優先する個人、およびインターネット接続に依存せずにAI機能にアクセスしたい人に最適です。次のような目的を持つユーザーに適しています。

- データ追跡やロギングを恐れることなく、検閲されていない会話に参加したい。

- iOSまたはmacOSデバイスでカスタムのAI駆動型ワークフローを作成したい。

- AIを搭載した文法修正および要約ツールを使用して、執筆を強化したい。

- 主要なオープンソースAIモデルを探索および実験したい。

モデルのパフォーマンスと量子化:

Private LLMの優れたモデルパフォーマンスは、最先端のOmniQuant量子化アルゴリズムの使用によるものです。このアルゴリズムは、最適化に基づいた学習可能な重みクリッピングメカニズムを採用することにより外れ値を処理し、モデルの重み分布を非常に高い精度で保持します。これは、他のオープンソースLLM推論フレームワークで使用されるRTN(最近傍への丸め)量子化とは対照的で、テキスト生成の品質が低下する可能性があります。

最高のオープンソースLLMをダウンロード:

Private LLMは、さまざまなAppleデバイス向けに最適化された幅広いオープンソースLLMをサポートしています。

- 4GB+ RAMを搭載したiPhone/iPadの場合: Meta Llama 3.2 1B、Google Gemma 3 1B、Qwen 2.5

- 6GB+ RAMを搭載したiPhone/iPadの場合: Meta Llama 3 8B、Phi-3 Mini 3.8B

- 8GB+ RAMを搭載したiPhone/iPadの場合: Meta Llama 3.1 8B、Google Gemma Based Models

- 16GB+ RAMを搭載したiPhone/iPadの場合: DeepSeek R1 Distill

- 8GB+ RAMを搭載したApple Silicon Macの場合: Meta Llama 3、Google Gemma 2/3

- 16GB+ RAMを搭載したApple Silicon Macの場合: Qwen 2.5、Phi-4、Google Gemma

- 24GB+ RAMを搭載したApple Silicon Macの場合: Yi 34B

- 32GB+ RAMを搭載したApple Silicon Macの場合: Mixtral 8x7B

- 48GB+ RAMを搭載したApple Silicon Macの場合: Meta Llama 3.3 70B

- 64GB+ RAMを搭載したApple Silicon Macの場合: Meta Llama 3.1 70B

ユーザーレビュー:

あるユーザーは、Private LLMを「独特のアプローチ」と「目に見えて優れた品質」で称賛しました。また、完全にローカルで実行されるにもかかわらず、開発者の倫理的な立場と寛大さにも感謝しました。

Private LLMは、AIに対するユニークで新鮮なアプローチを提供し、Appleデバイスでプライベートで安全な、検閲されていないAI体験を提供します。オフライン機能、主要なオープンソースAIモデルのサポート、およびSiriとショートカットとの統合により、Private LLMは、データの完全な制御を維持しながら、AIの力を活用できるようにします。

"Private LLM" のベストな代替ツール

LM Studioは、LLaMaやGemmaなどのオープンソース大規模言語モデル(LLM)をローカルPCで実行およびダウンロードするための使いやすいデスクトップアプリケーションです。アプリ内チャットUIとOpenAI互換のローカルサーバーを備え、プログラミングスキルなしでオフラインAIモデルとの対話を可能にします。

Privacy AIは、究極のデータプライバシーを保証するオフラインAIチャットボットハブです。インターネットなしでデバイス上でローカルに言語モデルを実行し、安全な会話を実現します。

NativeMindはオープンソースChrome拡張で、OllamaなどのローカルLLMを実行し、完全にオフラインでプライベートなChatGPT代替を提供。コンテキスト認識チャット、エージェントモード、PDF分析、執筆ツール、翻訳を特徴とし、すべてデバイス上で100%クラウド不要。

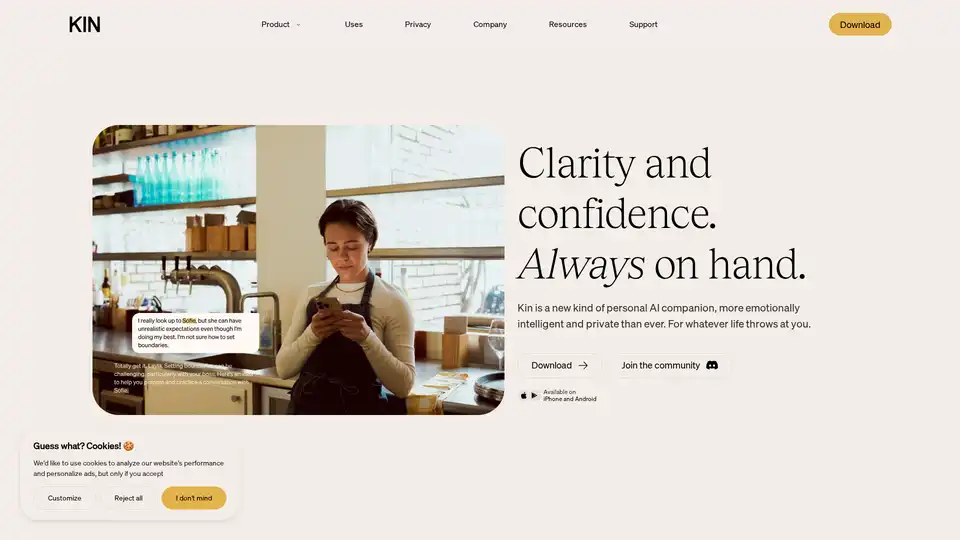

Kinを発見:人生の課題のためのプライベートで感情的にインテリジェントなパーソナルAIコンパニオン。iPhoneとAndroidでスマートメモリ、安全ストレージ、パーソナライズドガイダンスを提供。