Cloudflare Workers AI の概要

Cloudflare Workers AIとは?

Cloudflare Workers AIは、開発者がCloudflareのグローバルネットワーク上で直接機械学習の推論タスクを実行できる、サーバーレスのAIプラットフォームです。これにより、AIアプリケーションをユーザーの近くにデプロイできるため、パフォーマンスが向上し、レイテンシが短縮されます。複雑なインフラストラクチャのセットアップが不要になり、AIをアプリケーションに簡単かつ費用対効果高く統合できます。

Cloudflare Workers AIの仕組み

Cloudflare Workers AIは、Cloudflare Workersプラットフォームを活用して、Cloudflareのグローバルネットワーク全体に分散されたNVIDIA GPU上でAIモデルを実行します。これにより、追加のセットアップなしで生成AIタスクを実行できます。

主な機能は次のとおりです。

- GPU上のサーバーレスAI: NVIDIA GPUのグローバルネットワーク上でAIモデルを実行します。

- 事前トレーニング済みモデル: Llama-2、Whisper、ResNet50などの人気モデルのカタログから選択します。

- グローバルな可用性: REST APIを介して、Workers、Pages、または任意のサービスからAIモデルにアクセスします。

- ベクターデータベースの統合: Vectorizeを使用して、AIワークフローを強化するための埋め込みを生成および保存します。

- AI Gateway: キャッシュ、レート制限、および分析により、信頼性とスケーラビリティを向上させます。

- マルチクラウドトレーニング: マルチクラウドトレーニングアーキテクチャ向けに、R2を使用してコスト効率の高い、エグレスフリーのデータストレージを実現します。

Cloudflare Workers AIの使用方法

- モデルを選択: テキスト生成、画像分類、音声認識など、ニーズに基づいてWorkers AIカタログから事前トレーニング済みモデルを選択します。

- Workersとの統合: Cloudflare Worker内でWorkers AI APIを使用して、データをモデルに送信し、推論結果を受信します。

- グローバルにデプロイ: Cloudflareは、AIアプリケーションをグローバルネットワーク全体に自動的に分散し、世界中のユーザーに低レイテンシを保証します。

使用例:

- 画像分類: 画像内のオブジェクトまたはシーンを識別します。

- 感情分析: テキストの感情(ポジティブ、ネガティブ、ニュートラル)を判断します。

- 音声認識: 音声をテキストに変換します。

- テキスト生成: コンテンツのクリエイティブなテキスト形式を生成します。

- 翻訳: ある言語から別の言語にテキストを翻訳します。

Cloudflare Workers AIを選ぶ理由

- 低レイテンシ: ユーザーの近くでAIモデルを実行して、応答時間を短縮します。

- スケーラビリティ: Cloudflareのグローバルネットワークは、増加する需要に対応するために自動的にスケールします。

- 費用対効果: 従量課金制の価格設定により、初期インフラストラクチャへの投資が不要になります。このプラットフォームでは、課金が開始される前に、1日に10,000個の無料ニューロンが提供されます。

- 使いやすさ: 簡素化されたセットアップと他のCloudflareサービスとの統合により、AI開発が効率化されます。

- 強化された制御と保護: AI Gatewayは、LLMアプリケーションに制御と保護のレイヤーを追加し、レート制限とキャッシュを適用して、バックエンドインフラストラクチャを保護し、予期しない請求を回避できるようにします。

- 費用対効果の高いトレーニング: R2を使用したエグレスフリーストレージにより、LLMトレーニング用のマルチクラウドアーキテクチャを手頃な価格で実現できます。

Cloudflare Workers AIは誰のため?

Cloudflare Workers AIは、以下を検討している開発者や企業に最適です。

- 複雑なインフラストラクチャを管理せずに、AIをWebアプリケーションに統合する。

- 世界中のユーザーに高速で低レイテンシのAIエクスペリエンスを提供する。

- AIアプリケーションを効率的かつ費用対効果の高い方法でスケールする。

顧客の成功事例:

SiteGPT.aiの創設者であるBhanu Teja Pachipulusu氏は、次のように述べています。

「ストレージ、キャッシュ、キュー、そして最も重要なのはトレーニングデータとエッジへのアプリのデプロイなど、すべてにCloudflareを使用しているため、製品の信頼性と高速性を確保できます。また、最も手頃な価格のオプションであり、競合他社は1日のリクエストに対してCloudflareの1か月分の費用よりも多くを請求します。」

"Cloudflare Workers AI" のベストな代替ツール

Runpodは、AIモデルの構築とデプロイメントを簡素化するAIクラウドプラットフォームです。 AI開発者向けに、オンデマンドGPUリソース、サーバーレススケーリング、およびエンタープライズグレードの稼働時間を提供します。

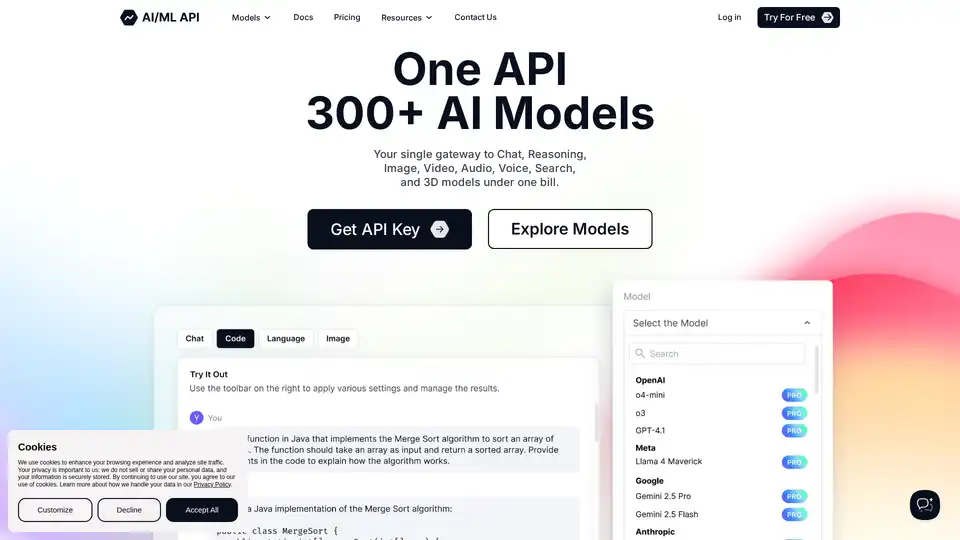

AIMLAPI は、チャット、推論、画像、ビデオ、オーディオ、音声、検索、3D 用の 300 以上の AI モデルにアクセスするための単一の API を提供します。高速な推論、トップレベルのサーバーレスインフラストラクチャ、堅牢なデータセキュリティを提供し、OpenAI と比較して最大 80% の節約を実現します。

GPUXは、StableDiffusionXL、ESRGAN、AlpacaLLMなどのAIモデル向けに1秒のコールドスタートを実現するサーバーレスGPU推論プラットフォームで、最適化されたパフォーマンスとP2P機能を備えています。

開発者向けの超高速AIプラットフォーム。シンプルなAPIで200以上の最適化されたLLMとマルチモーダルモデルをデプロイ、ファインチューニング、実行 - SiliconFlow。